openclaw部署

本人是采用的npm安装,采用ollama本地大模型部署+openclaw进行测试

但是,说实话,没啥条件的真别上ollama+openclaw的思路,目前开源的小参数本地大模型能力有限,工具调用能力很差,逻辑思维不缜密,很容易搞混淆与出错,老老实实用API就行

本次测试设备条件:

CPU:AMD R9-8945HX

内存:32G DDR5 5200Mhz

GPU:NVIDIA GeForce RTX 5060 Laptop 8G

系统:windows11 24H2

环境:Node.js 22.22.2

python3.11.6

需要满足的环境条件:

建议Node.js ≥22.22.2(LTS)

python3

建议直接在wsl或者虚拟机里部署

可以通过以下方式安装

##Macos/Linux

方式一:One-liner:

curl -fsSL https://openclaw.ai/install.sh | bash

方式二:npm:

#windows

# Install OpenClaw

npm i -g openclaw

# Meet your lobster

openclaw onboard

方式三:

下载安装包https://github.com/openclaw/openclaw/releases/latest

验证安装

openclaw --version

安装时间大概在几分钟到几十分钟不等,取决于你的网络状态;安装的过程网络可能不太稳定,容易断开,这很正常;分析一下原因多试几次

安装OpenClaw后,我们还需要:

- ✅ 配置OpenClaw连接API

- ✅ 设置默认模型

- ✅ 安装相关技能包

- ✅ 测试基本功能

初始化配置向导

# 启动配置向导

openclaw onboard

这将启动一个交互式配置流程

1️⃣ 安全声明

I understand this is powerful and inherently risky. Continue?

输入: yes

2️⃣ 配置模式

选择: QuickStart (Configure details later via openclaw configure.)

3️⃣ 模型/认证提供商

选择: 第三方站点购买的API,滚动到最后选择 Custom Provider或者你购买的API对应的提供商

本地ollama部署建议在这里选择ollama最好,不然后续还得修改

4️⃣ API Base URL

输入:

http://127.0.0.1:11434/v1

本地回环地址,安全无暴露,不会被外网扫描、不会泄漏模型服务,隐私与安全拉满

5️⃣ API Key

你自己买的API key

Ollama本地大模型不需要真实密钥,留空就行

6️⃣ 端点兼容性

Endpoint compatibility

选择: OpenAI-compatible

7️⃣ 模型ID

Model ID

选择你的主力模型

后续步骤:

1️⃣ Model configuration

Model configuration options

选择: 按Enter接受默认配置

2️⃣ Channels配置(消息平台)

Select channel (QuickStart)

选择: Skip for now(暂时跳过,稍后配置)

3️⃣ Skills配置(技能包)

Configure skills now? (recommended)

选择: No(暂时跳过,openclaw启动之后可以自行安装技能包)

4️⃣ Hooks配置

Enable hooks?

选择: 可以跳过,或选择启用推荐的hooks

5️⃣ 完成配置

Setup complete!

然后你可以尝试打开你的网关

命令行 A:openclaw gateway → 保持打开

另外打开一个命令行 B:openclaw dashboard → 自动打开网页

你就会进入http://127.0.0.1:18789/* * * * * * * *

在你第一次跟openclaw进行对话的时候,它会向你索要soul和identity等核心文件,这个时候你一定要准备好。有关soul和identity的可以参考https://lunarveil.top/post/openclaw%E5%8F%82%E8%80%83%E6%A1%88%E4%BE%8B%E4%BB%85%E4%BE%9B%E5%8F%82%E8%80%83%E6%A6%82%E4%B8%8D%E8%B4%9F%E8%B4%A3/

这个过程中如果有哪些地方有做错的,后续也是可以修改的

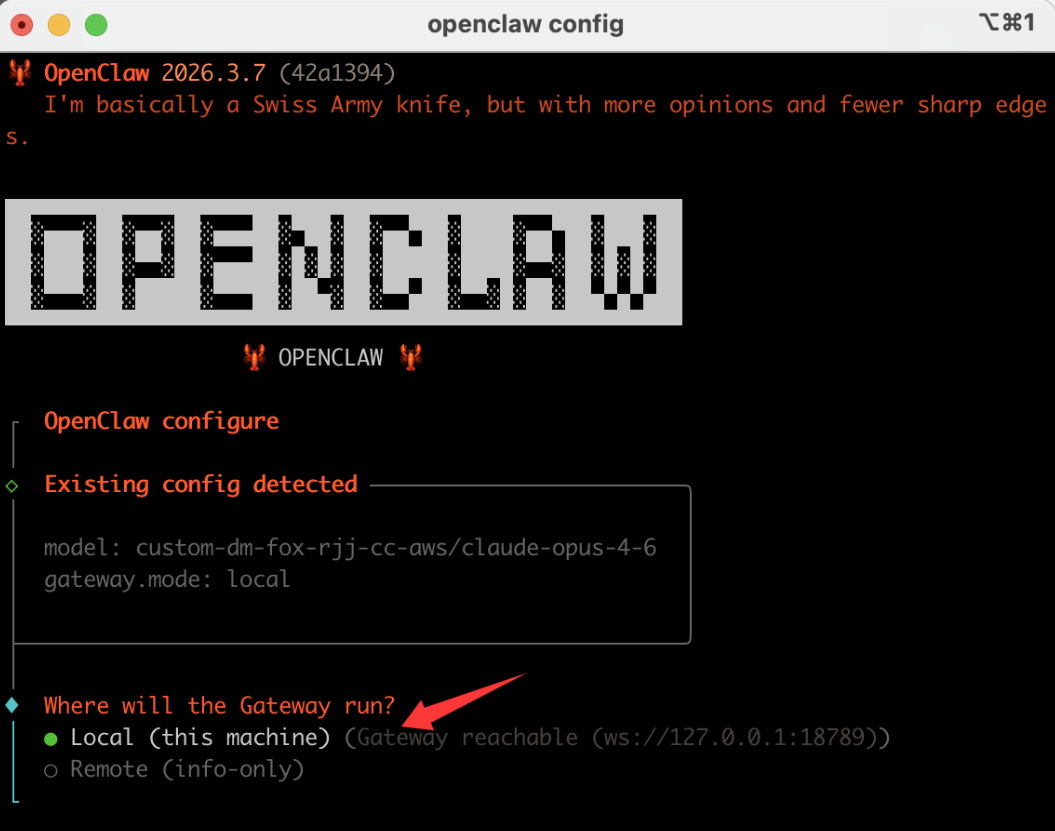

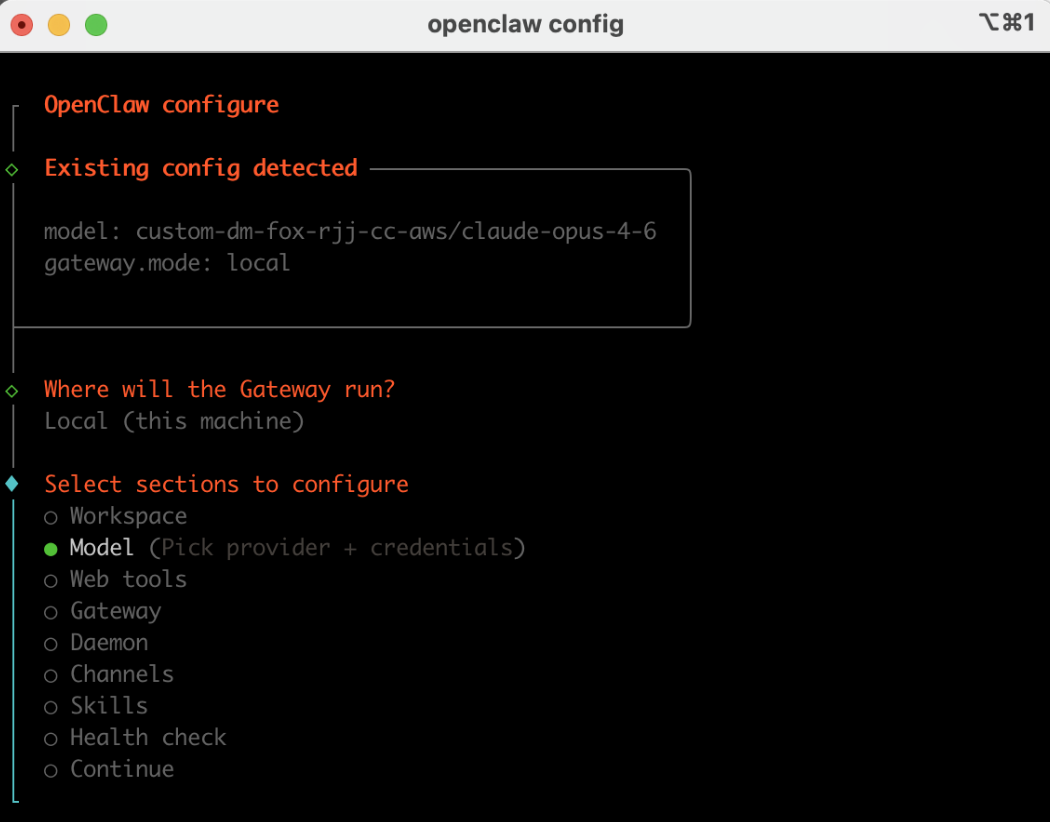

配置自定义模型接口

打开终端输入openclaw config 配置model和接入

在这里就可以选择有需要修改的步骤